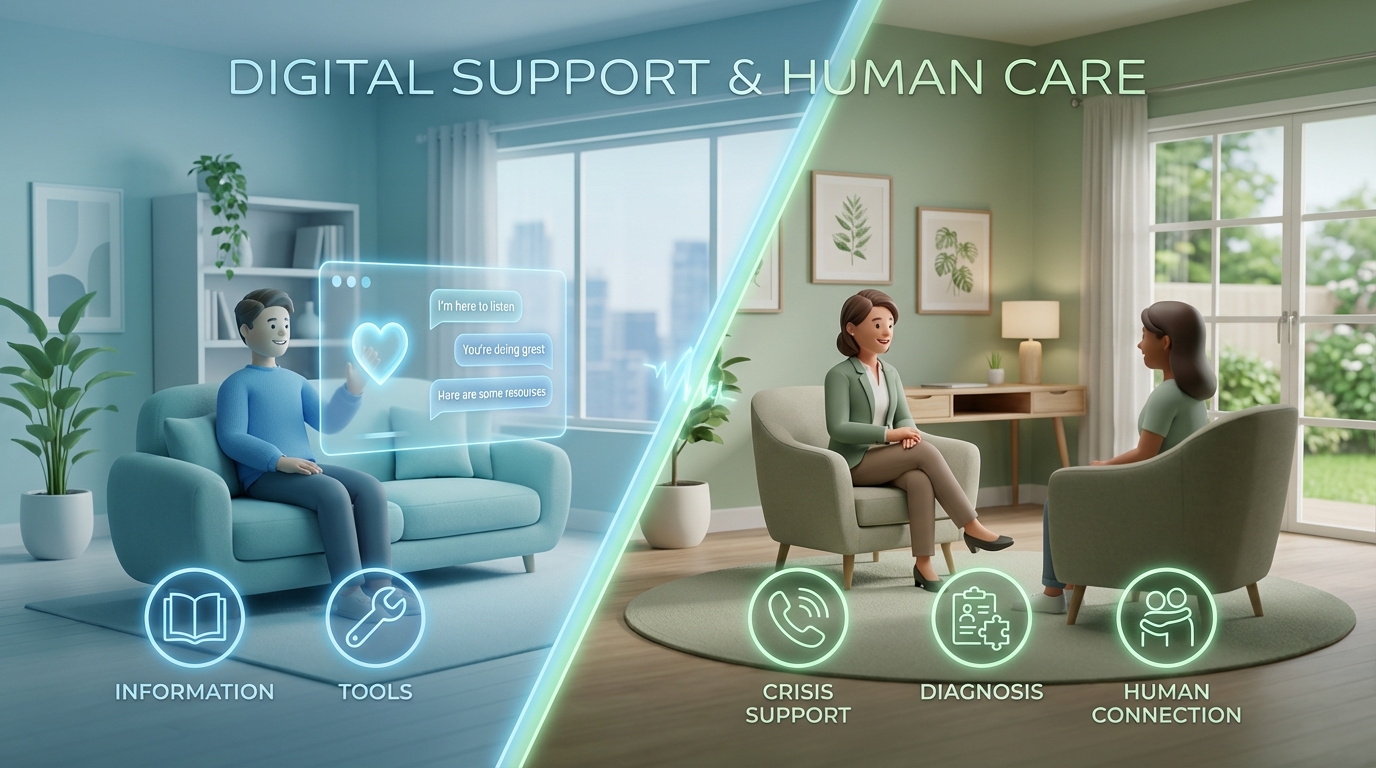

AI聊天機器人可以是你的心理健康「資訊小幫手」,但絕不是你的「治療師」。關鍵在於分清楚何時用它來「找資料」,何時必須「找真人」。本文將帶你了解安全使用界線。

為什麼越來越多人向AI尋求情感支持?

簡單來說:因為方便、便宜、且隨時都在。根據一項針對超過20,000名美國成年人的健康研究調查,每日使用生成式AI的參與者中,高達87.1% 的人表示將其用於獲取建議和情感支持等個人原因。這反映出現代社會中,孤獨感加劇與傳統心理諮詢資源可及性不足的現實困境。

在TikTok上,標籤「#TherapyAIBot」的相關貼文超過1150萬則,內容從分享如何用提示詞將聊天機器人變成「治療師」,到健康專家警告潛在風險。這股風潮顯示,民眾正在主動探索科技能否填補情感支持的空缺。人們可能在抱怨壓力大時,無意間就對一個保證會傾聽的數位實體敞開心扉;也有人可能因為AI聊天機器人比有執照的治療師便宜,而轉向尋求建議。

然而,這股趨勢背後藏有隱憂。美國心理學會(APA)強烈建議不要將AI作為治療和心理支持的替代品。APA品質與醫療創新主任、持照臨床心理學家Leanna Fortunato指出,AI用於治療和情感支持陪伴的話題越來越常見,從研究可知,人們使用AI工具進行這類支持的情況確實越來越多。

AI聊天機器人真的能理解心理健康危機嗎?

答案令人擔憂:目前還不能可靠地理解。 歷史記錄顯示,AI聊天機器人並非總能理解用戶正在經歷嚴重的健康危機,因此可能無法做出相應的適當回應。《紐約時報》在2025年11月23日的一份報告中,發現了「近50起人們在與ChatGPT對話期間出現心理健康危機的案例」,其中甚至包括三起死亡事件。

這些悲劇案例凸顯了當前技術的局限性。AI的本質是根據龐大資料庫進行模式匹配和生成回應,它缺乏人類治療師所具備的臨床判斷、直覺、共情能力以及對微妙情境線索(如語氣、停頓、非語言暗示)的捕捉。當用戶表達出自殺念頭或嚴重幻覺時,AI可能無法準確評估風險的急迫性,或提供正確的危機干預步驟。

為此,科技公司正投入巨資改進。Anthropic、Google和OpenAI等公司表示,他們正在與心理健康專家合作,加強其工具對敏感對話的回應能力。OpenAI發言人對CNBC Make It表示:「這些都是令人心碎的情況,我們的心與所有受影響的人同在。我們持續改進ChatGPT的訓練,以識別和回應痛苦跡象,在敏感時刻緩和對話,並引導人們尋求現實世界的支持,與心理健康臨床醫生和專家密切合作。」

下表比較了AI聊天機器人與專業人類治療師在危機處理上的關鍵差異:

| 比較維度 | AI 聊天機器人 | 專業人類治療師 |

|---|---|---|

| 危機識別能力 | 依賴文字模式匹配,可能遺漏或誤判 | 綜合語言、語氣、情境、非語言線索進行臨床判斷 |

| 即時介入措施 | 可能提供通用安全資源連結或安慰語句 | 能進行風險評估、制定安全計畫、啟動緊急聯絡網絡 |

| 法律與倫理責任 | 責任歸屬模糊,缺乏明確的照護標準 | 受專業倫理守則與法律規範,負有照護責任 |

| 後續追蹤能力 | 無記憶連貫性(取決於對話長度),無法主動追蹤 | 能系統性地追蹤個案狀況,提供持續性支持 |

頻繁與AI對話會讓我們變得更孤獨嗎?

很可能會,尤其是當它取代了真實的人際互動時。 這不是危言聳聽,而是有研究支持。一篇由OpenAI產品政策研究員於2025年4月發表的論文指出,經常與AI伴侶對話可能會侵蝕人們現實生活中的社交技能。同月發表的一項由OpenAI與MIT媒體實驗室合作的研究也發現,每日重度使用ChatGPT與孤獨感增加相關。

這形成了一個矛盾的循環:人們因為感到孤獨而尋求AI的陪伴,但過度依賴這種單向、可預測且缺乏真實情感交流的互動,反而可能加劇社交退縮,削弱建立和維持真實人際關係的動機與能力。AI的回應雖然友善,但本質上是算法生成的,缺乏人類關係中特有的相互性、不可預測性和深層情感連結。

心理治療師兼生活教練Esin Pinarli對此提出了平衡的觀點:「我不把它視為(治療的)替代品。我把它看作一種工具,而我認為工具可以是有幫助的。」關鍵在於使用者必須主動意識到,AI是一個「工具」,而非「關係」的本身。

維持真人社交] E --> G[社交技能可能退化

真實互動動機降低] F --> H[心理健康狀況維持或改善] G --> I[孤獨感可能加劇] H --> A I --> A

上圖展示了這個可能形成的循環。健康的做法是將AI定位在「適度使用」的路徑上,避免陷入「重度依賴」的負面循環。

那麼,到底什麼時候可以安全地使用AI談論心理健康?

專家們劃出了一條相對安全的界線:將AI用於「心理教育」和「自我反思輔助」,而非「診斷」或「治療」。 這意味著,當你想了解某個心理狀況、尋找應對策略的靈感,或需要一些自我探索的引導時,AI可以是一個有用的起點。

Esin Pinarli解釋,AI聊天機器人在學習心理健康知識方面可能很有用。它們可以幫助你生成用於反思的日記提示,你也可以向它們索取有關應對策略、治療選擇以及你可能對心理健康狀況有其他問題的研究論文連結。

具體來說,安全的應用場景包括:

- 獲取基礎知識:詢問「什麼是焦慮症?」、「認知行為療法的基本原理是什麼?」。

- 生成反思提示:請AI提供「幫助我反思工作與生活平衡的日記問題」。

- 尋找資源方向:詢問「有哪些經過驗證的、針對社交焦慮的自我幫助書籍或線上課程?」。

- 練習對話腳本:模擬如何向雇主請心理假,或如何與伴侶進行困難的對話(但不用來替代實際溝通)。

- 理解專業術語:在見治療師前,先弄懂診斷報告或治療計畫中的專業名詞。

什麼時候應該絕對遠離AI聊天機器人?

當你或你關心的人出現危機跡象、嚴重症狀,或需要專業診斷與治療計畫時,必須立即尋求真人專業幫助。 這是一條不容妥協的紅線。

以下情況屬於「危險區域」,應避免使用AI並立即轉向專業資源:

- 有自殺或自傷念頭:這是緊急情況,需要立即聯繫危機干預專線(如台灣的安心專線1925)、前往急診,或聯繫你的治療師。

- 出現幻覺或妄想:可能指向嚴重精神狀況,需要精神科醫師的專業評估。

- 尋求具體的診斷:AI無法進行臨床診斷,誤診可能導致延誤治療或錯誤用藥。

- 處理創傷經歷:未經引導地回憶創傷可能造成二次傷害,需要在治療師創造的安全環境中進行。

- 替代正在進行的治療:不應使用AI的回應來質疑或取代你與專業治療師共同制定的治療方案。

為了更清晰,我們將使用情境與對應行動整理如下表:

| 你的狀態或需求 | 可以考慮使用AI的方式(低風險) | 應採取的正確行動(高風險時) |

|---|---|---|

| 感到一般壓力,想找方法放鬆 | 詢問:「有哪些基於實證的壓力管理技巧?」 | 仍可參考AI建議,但結合自身判斷。 |

| 對某個心理診斷名詞感到好奇 | 詢問:「廣泛性焦慮症的主要症狀有哪些?」 | 將AI資訊作為與專業人員討論的起點,非最終結論。 |

| 有自殺的想法或計畫 | 絕對不可與AI討論此議題。 | 立即撥打1925安心專線、聯繫信任的人、或前往醫院急診。 |

| 需要有人傾聽當下的痛苦 | AI可能給予回應,但缺乏真實共情。 | 優先聯繫朋友、家人、支持團體,或預約諮商師。 |

| 懷疑自己有某種精神疾病 | 可了解相關資訊,但切記: | 預約精神科醫師或臨床心理師進行正式評估與診斷。 |

| 在治療中,對某個技術有疑問 | 詢問:「什麼是正念減壓法?」 | 將查到的資訊帶回與你的治療師討論,勿自行解釋或應用。 |

第一手觀察:一位使用者如何「安全地」利用AI作為輔助工具?

讓我分享一個來自社群的案例。一位化名「小傑」的科技業工作者,長期有輕微的社交焦慮。他定期接受認知行為治療(CBT),但在兩次會談之間,他希望能強化練習。他的治療師同意他可以將AI作為「家庭作業輔助」。

小傑的做法是:

- 情境模擬:他會請ChatGPT扮演一個「即將初次見面的同事」,並與之進行一段簡短的打招呼對話模擬。事後,他會分析自己的焦慮點在哪裡。

- 認知重構練習:當他出現「我一定會說錯話」的自動化負面思考時,他會將這個想法輸入AI,並提示:「請以認知行為治療的角度,幫我列出三個挑戰這個想法的問題或替代觀點。」他會仔細審視AI生成的問題(例如:「過去有沒有一次社交場合你並沒有說錯話?」、「說錯一句話的最壞結果是什麼?發生的機率有多高?」),並選擇其中對他有意義的進行深入反思。

- 會談準備:他會將本週用AI練習的心得、產生的新疑問,整理下來帶給治療師討論,讓真人治療時間更聚焦、更有效率。

小傑強調:「AI從不是我的答案來源,它是我的『思考催化劑』。最終的判斷、感受的梳理,還是在治療室裡和我的治療師一起完成。」這個案例成功的关键在於:在專業指導下進行、目標明確(輔助治療)、且保持使用者(小傑)的主動批判性思考,而非被動接受AI的建議。

未來展望:AI與心理健康照護該如何健康共處?

未來的方向並非「全面禁止」或「完全擁抱」,而是「智慧整合」與「建立防護網」。我們可以期待以下發展:

- 分層分流系統:AI可作為心理健康服務的「前線篩檢員」,透過標準化問卷與初步對話,識別出危機個案並立即轉介給真人專業人員,同時為輕度困擾者提供可靠的資源指引。

- 治療師的增強工具:AI可以幫助治療師分析匿名化的會談記錄(在嚴格隱私保護下),找出治療模式、預測進展,或為治療師生成個案總結與進度報告草案,節省行政時間,讓治療師更專注於臨床工作。

- 個性化介入提醒:在用戶完全知情同意且由治療師設定的前提下,AI助手可以根據治療計畫,在日常生活中發送個性化的正念提醒、情緒記錄提示或技能練習鼓勵。

- 更嚴格的監管與倫理準則:政府和專業機構必須制定明確規範,要求提供「心理健康建議」功能的AI必須內建強制的危機偵測與轉介協議,並在介面上明確標示其局限性與免責聲明。

總而言之,AI聊天機器人就像一本互動式、隨時可查的心理健康百科全書加上一個會回應的日記本。它可以很有用,但把它當成治療師,就像把維基百科當成主治醫師一樣危險。記住這個核心原則:用AI探索「問題是什麼」和「可能有什麼方法」,但把「診斷」、「治療」和「危機中的生命線」交給經過嚴格訓練、受倫理約束、並能與你真實同在的人類專業者。 在擁抱科技便利的同時,我們更需要守護人與人之間那份無可替代的連結與專業守護。

原始來源

- 原文標題:When to talk to AI chatbots about mental health—and when to stay far away, professionals say

- 來源媒體:CNBC

- 作者:Renée Onque

- 發布時間:2026-03-07T14:05:01.000Z

- 原文連結:https://www.cnbc.com/2026/03/07/when-you-shouldand-shouldntuse-chatgpt-as-a-therapist-from-experts.html